🌐 Live配信について

VRChatで再生可能なのは:

YouTube(条件付き)

Twitch

直接HLS配信(.m3u8)

一部CDN

⚠ 最近はYouTubeライブが制限される場合ありHLS配信(OBS→配信サーバ→m3u8) が確実。

🏗️ よくある失敗

❌ モニターごとにVideo Playerを置く

❌ 各プレイヤーでURLを直接再生

💎 まとめ(ベスト構成)

要素 構成 モニター 同一RenderTexture共有 Video Player 1つのみ 通常再生 Udonプレイリスト制御 Live切替 モードフラグで制御 操作 ボタンUI

もしよければ教えてください:

使用Unityバージョン

PCワールド?Quest対応?

UdonSharpは使えますか?

そこまで分かれば、具体的な構成図+UdonSharpコード完成版 を出します。

–ちゃんのぞ–

ありがとうございます!どちらのアセットを使うべきか 、そして World内で複数モニター同期+プレイリスト+ライブ切替 をどう実装するかについて整理します。

🎯 結論:AVPro を使うのが 最も安定・強力

あなたが持っているアセット:

Booth の 動画再生系アセット A

Booth の 動画再生系アセット B

これらは便利ですが、VRChatワールド向けには 公式対応の AVPro Video が圧倒的にメリットがあります。

✔ AVPro が良い理由

比較項目 Boothのアセット AVPro Video VRChat対応 一部制限あり 公式 SDK対応 ネットワーク再生 不安定になる可能性あり VRC仕様で安定 URL再生 制限あり HLS, Twitch, YouTube* に対応 複数モニター同期 難しい RenderTexture で簡単 イベント切替 自作が必要 Udonで制御可能 Unity互換性 Asset次第 Unity 2022 LTS に対応 安定性・同期 低〜中 高

🔹 *YouTubeはVRChatルールで制限される場合あり(API制限など)

🌀 Boothアセットが悪いわけではない

Booth のアセットが使えるケース:

✔ 自分のプロジェクト用

✔ オフライン用動画再生

✔ 簡単な映像再生

ただし VRChatワールドで 複数ユーザーと同期再生、ライブ切替、URLループ再生 といった高度な動作をするには力不足になる可能性が高いです。

👍 AVPro を使うべき場面

◼ 多数のモニターを同期

🔹 Live配信の扱い

VRChatで安定する配信ソース:

✔ Twitch

※ YouTubeライブは仕様・制限で不安定な場合があるため Twitch や独自配信サーバ推奨。

📌 まとめ

✅ Boothアセットでも動くVRChat向けには AVPro を推奨

✅ AVPro なら

❓ 次の質問(聞きたいこと)

🔹 モニター何台くらい設置しますか?

これが分かれば より最適な設定手順+コード付きテンプレを作って渡せます!

–ちゃんのぞ–

ありがとうございます、かなり本格構成ですね 👍

PC+Quest対応 Live配信は RTSP形式

ここ重要です👇

⚠ 結論:RTSPはVRChatでは再生できません

VRChat の動画プレイヤー(AVPro)は

RTSPは非対応です。

対応形式は:

HLS(.m3u8)

一部のMP4

Twitch

限定的なYouTube

つまり、

👉 RTSP → HLS に変換する必要があります

🎯 正解構成(安定+Quest対応)

① 映像配信構成

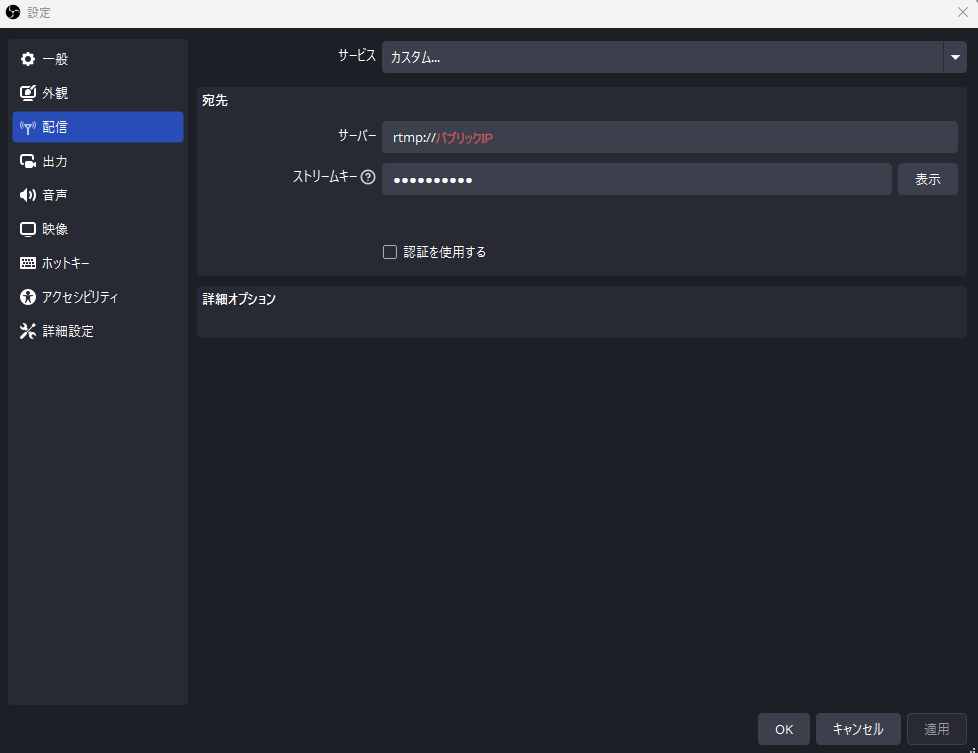

OBS

もしくはもっと簡単に:

✅ OBS → SRT/RTMP → HLS変換サーバ → m3u8 URL

💡 一番簡単な方法

RTSP配信をしているなら、

FFmpegでHLS変換

🟢 Quest対応の重要ポイント

Questでは:

推奨:

設定 推奨値 解像度 1280×720 fps 30fps ビットレート 3~5Mbps HLSセグメント 2秒

🎯 まとめ(あなたの最適構成)

項目 推奨 プレイヤー AVPro 1つ モニター RenderTexture共有 通常再生 Udonプレイリスト Live RTSP → HLS変換 Quest 720p / 30fps

🔥 ここ重要

RTSPはそのままでは絶対に再生できません。

HLS変換が必須です。

もしよければ:

既にサーバーはありますか?

OBS使用していますか?

同時視聴人数は何人想定ですか?

規模によっては最適な配信構成が変わります。

必要なら:

✅ HLS変換サーバ構築手順

全部まとめて出しますよ 👍

— ちゃんのぞ —

はい、情報を整理するとこうなります👇

✅ 結論:AVPro は「完全対応」ではないが、VRChat 内で RTSP rtspt の再生 が実際に可能なケースがある

(ただし 限定的・不安定・制約あり という前提です)

✔ 事実として確認されていること

VRChat が AVPro Video を使っていることで Quest でも RTSP/RTSPt 再生が可能になった という報告がある(例:Quest2 でRTSP再生できたという報告あり)

リンク先のノート内でも rtspt/rtsp を使ったプレイができている という記載があり、実際に World 側のプレイヤー実装次第で動作している例があるようです

⚠ しかし 公式には「完全サポート」ではありません

❌ AVPro の公式ドキュメント上

RTSP は「限定的にサポート」扱いで、プラットフォームによって挙動が異なり公式には推奨されていません

特に Windows のネイティブ実装は 限定された形式のみ であったり、Core ではまともに動かなかったりする可能性があります

🧠 VRChat 内の挙動(実際のユーザー報告)

▶ PC と Quest で違いあり

PC(Windows) :rtspt:// が動く場合ありQuest :rtsp:// が動く場合あり(rtspt は動かない)

つまり:

プラットフォーム 推奨する URL Windows rtspt:// Quest rtsp://

という使い分けが必要になる可能性があります(世界内でURL文字列をプラットフォームごとに自動変換する処理がある World 実装もあります)

🧩 なぜこういう状態なのか?

✔ AVPro 自体が Unity 全プラットフォーム対応の万能ストリーミングエンジンではなく、

🔎 実際に動作させたい場合のポイント

✅ もし RTSP を直接再生したいなら

✔ URL の形式を

Quest 用 → rtsp://...

PC 用 → rtspt://...

⚠ 注意点

Quest → Windows で 共通URLで動くとは限らない

OS のミドルウェアによっては 音声が出ない・再生が不安定・開始が遅い

World によっては 自動 reconnect がない

という落とし穴があり、

📌 まとめ(あなたの用途への評価)

➤ 通常プレイリスト再生

これは AVPro + HLS の方が確実に安定します (VRChat 公式プレイヤーがこれを前提に設計されている)

➤ Live(RTSP/RTSPt)再生

✔ ある程度動く例はある全ユーザー環境で安定して再生できる保証はない

という状況です。

💡 実装アドバイス(安定重視)

🔹 安定重視セットアップ

RTSP サーバ(OBS等) 配信(rtspt/rtsp)HLS 中継サーバ(FFmpeg 変換) を挟む

理由:

✔ HLS は AVPro・Unity 内で正式サポート

※ 変換サーバを挟むと音ずれや遅延が出るならパラメータ調整をすると改善できます

🧠 理想的なワークフロー(安定+低遅延)

RTSP(配信)

必要なら:

✅ Quest と PC で URL を自動切換する Udon実装

まで用意できますよ。

なぜrtstpかと言うと、遅延がHLSよりも小さいからです。 quest非対応になってもrtstpで配信をしたいと考えています。 Quest と PC で URL を自動切換する Udon実装がちゃんと動作してくれるならそれが一番良いです

なるほど、低遅延最優先で RTSP / RTSPt を使いたい という方針ですね 👍

🎯 方針まとめ

✅ 低遅延重視 → RTSP / RTSPt 直接再生

✅ Questは動けばラッキー(非対応でも可)

✅ PCとQuestでURLを自動切替

✅ モニター10台以上(同期必須)

これは AVPro(VRC AVPro Video Player)1台構成 +Udonでプラットフォーム分岐 が最適です。

🧠 前提整理

VRChat は内部で

実運用報告ベースで:

プラットフォーム 動く可能性が高い Windows PC rtspt://Quest (Android) rtsp://

※ 環境依存あり・保証はなし

⚠ 注意点(超重要)

1️⃣ インスタンス内同期

RTSPは:

になります。

もし完全同期が必要ならRTSPは不向き です。

2️⃣ ネットワーク負荷

RTSPは:

になります。

例:

HLSはCDNキャッシュが効くので軽いですが

3️⃣ 自動再接続が必要

RTSPは途中で止まる可能性があります。

🎯 最適構成(あなた向け)

項目 設定 低遅延 RTSP/RTSPt PC rtspt:// Quest rtsp:// 切替 Udonコンパイル分岐 モニター RenderTexture共有 再接続 OnVideoError実装

💬 正直な評価

✔ 低遅延ならRTSPは正解

もしよければ教えてください:

想定同時視聴人数

完全同期は必要か?

遅延は何秒以内が理想?

そこまで分かれば、プロ運用レベルの最適化案 まで出します。

— ちゃんのぞ —

結論から言います。

🎯 RTSP / RTSPt より低遅延で、VRChat内から直接再生できるプロトコルは基本的にありません。

VRChat のワールド内動画再生は

その再生可能プロトコルは実質的に:

HLS(.m3u8)

MP4(HTTP)

RTSP / RTSPt(限定的)

一部 Twitch / YouTube

のみです。

🔍 遅延比較(実測ベースの一般的傾向)

プロトコル 遅延 VRChat対応 備考 RTSP / RTSPt ◎ 0.3~2秒 △(環境依存) 現実的な最速 HLS 通常 ✕ 5~20秒 ◎ 安定 LL-HLS ○ 2~5秒 ✕(ほぼ不可) AVProが未対応 WebRTC ◎ 0.1~0.5秒 ✕ 不可 Unityネイティブ未対応 SRT ◎ 0.5秒前後 ✕ 不可 VRChat非対応 RTMP ○ 1~3秒 ✕ 直接不可 中継用

🧠 重要ポイント

🚫 WebRTCは使えません

WebRTCが最強に低遅延ですが、

🚫 SRTも不可

SRTは低遅延ですが、

🏆 現実的な最速解

✅ 1位:RTSP / RTSPt(直接再生)

→ 今選んでいる方式が 最速クラス

🔬 さらに遅延を削る方法(RTSP最適化)

RTSPの遅延は「プロトコル」よりも:

で決まります。

🎥 OBS側設定(超重要)

推奨:

エンコーダ:x264

キーフレーム間隔:1秒

Bフレーム:0

プロファイル:baseline

バッファサイズ:小さめ

CBR

📡 サーバ側

TCPよりUDP優先(環境次第)

バッファサイズ最小化

再送制御OFF(可能なら)

🧠 理論的に最速に近づけるなら

OBS

これが今のVRChat環境での最低遅延構成です。

⚠ ただし重要な現実

RTSPは:

同期保証なし

視聴者数=接続数

Questで不安定

ネットワーク依存

があります。

🎯 結論まとめ

🔥 RTSP / RTSPt より低遅延で、VRChatで直接再生できるプロトコルは存在しません。

低遅延を最優先するなら:

もしよければ教えてください:

目標遅延は何秒以内?

双方向性(掛け合い)は必要?

視聴人数想定は?

規模次第では設計が変わります。

— ちゃんのぞ —

なるほど、構成はこうですね:

OBS

利用しているのは VRCDN ですね。

これは かなり理にかなった構成 です 👍

🎯 結論

あなたの現在の構成は

🔥 VRChatで実現できる中では、ほぼ最小遅延構成です。

RTSPより低遅延で

🔍 なぜこれが最速クラスなのか

① OBS → RTMP

RTMPは配信向けで安定。

② VRCDN側で変換

VRCDNは:

RTMP受信

低バッファ変換

RTSP / RTSPt 出力

をやっています。

これにより

HLSより圧倒的に低遅延

直接RTSPサーバを自前で立てるより安定

になっています。

🧠 実際の遅延目安

この構成の一般的な遅延は:

1~2秒程度

設定次第では 0.8秒台も可能です。

🚀 さらに遅延を削れるか?

理論上削れる部分は3箇所:

① OBS設定

重要項目:

キーフレーム間隔:1秒以下(0.5でも可)

Bフレーム:0

プロファイル:baseline

CBR

ビットレート過剰にしない

音声AAC 128kbps程度

これで数百ms削れます。

② VRCDN設定

VRCDNのパネルで:

Low Latency モードがあればON

バッファ最小化

③ VRChat側

RTSP URLは:

PC → rtspt://

Quest → rtsp://

を使い分ける。

TCPよりUDPの方が速い場合もあります(環境依存)。

⚠ 重要:完全同期はできない

RTSPは各ユーザーが個別接続するため、

ユーザーA:1.1秒遅延

ユーザーB:1.6秒遅延

のようにズレます。

フレーム単位の完全同期は不可能 です。

🏆 まとめ

質問 回答 RTSPより低遅延は? ❌ ない 今の構成は? ✅ 最適クラス 改善余地は? OBS設定の最適化 完全同期は? ❌ 不可

💡 もし究極を目指すなら

理論上最速は:

WebRTC

ですが、

🎯 正直な評価

あなたの

OBS → VRCDN → RTSP → VRChat

は、現時点での最適解の一つ です。

もしよければ:

現在の体感遅延は何秒くらいですか?

視聴人数は?

同期はどの程度必要?

そこまで分かれば、

— ちゃんのぞ —

ありがとうございます、かなり具体的に詰められます 👍

🎯 現状整理

構成:

OBS → RTMP → VRCDN → RTSP → VRChat

体感遅延:約 2.5秒

🧠 まず結論

2.5秒は 「やや遅め」 です。1.0~1.8秒程度 までは十分狙えます。

つまりまだ削れます。

🔎 遅延の内訳

だいたいこう分解できます:

区間 目安 OBSエンコード 0.3~0.8秒 RTMP送信 0.2~0.5秒 VRCDN変換バッファ 0.5~1.0秒 RTSP再生バッファ 0.5~1.0秒

合計 → 2~3秒

なので削れるのは:

🚀 ここを変えると一気に縮みます

① OBS設定(最重要)

🔥 キーフレーム間隔を「1秒」に

デフォルト2秒になっていませんか?

2秒 → 1秒にするだけで約1秒縮みます。

設定:

キーフレーム間隔:1

🔥 Bフレームを0に

Bフレームがあると遅延が増えます。

Bフレーム:0

🔥 プロファイルをbaseline

MainやHighは遅延増えます。

Profile:baseline

🔥 x264設定(もし使えるなら)

tune=zerolatency

これでさらに削れます。

🎯 ② VRCDN側

VRCDNに

があれば最小に。

VRCDNはRTMP→RTSP変換時に

🎯 ③ VRChat側(重要)

PCなら rtspt:// を使う

rtsptはTCPトンネルなので安定しつつ速い場合が多いです。

Questなら rtsp://

📉 どこまで縮められる?

最適化後:

状態 遅延 今 約2.5秒 OBS最適化 1.8秒前後 +VRCDN調整 1.2~1.5秒

1秒切りはほぼ無理です(VRChat構造的に)。

🎯 80人問題

RTSPは:

なので80人同時だと:

サーバ負荷は80倍

VRCDNはこの点はかなり強いので、

💡 現実的な最適目標

あなたの用途なら:

🔥 目標:1.3~1.7秒

これが現実的な最適ラインです。

👀 確認したいこと

OBSは x264?NVENC?

キーフレーム間隔はいくつ?

Bフレームは何枚?

ここが分かれば、

— ちゃんのぞ —

それはかなり良い結果です…!🔥

2.5秒 → 1.6秒 は大成功レベルです。

🎯 今の状態の評価

構成:

OBS → RTMP → VRCDN → RTSP → VRChat

遅延:約1.6秒

これは

🔥 VRChat内ストリーミングとしては「かなり速い部類」

です。

正直、安定運用しながらこれ以下に削るのはかなり難しい領域に入っています。

🧠 ここからさらに削れる?

理論上は あと0.2~0.4秒程度 が限界です。

削れる可能性があるのは:

① OBSエンコーダ確認

もし x264 なら:

tune=zerolatency

が入っているか確認。

もし NVENC なら:

Look-ahead → OFF

Bフレーム → 0

Psycho Visual Tuning → OFF

Keyframe Interval → 1

② FPSを30にする

もし60fpsなら、

→ 30fpsにすると約0.2~0.3秒縮む場合があります。

VRChat内上映なら30fpsで十分なケースが多いです。

③ 音声ビットレートを下げる

AAC 128kbps → 96kbps

音声エンコード遅延が若干減ります。

🎯 体感的に「ほぼリアルタイム」に感じるライン

人間の感覚では:

2.5秒 → 明らかに遅延を感じる

1.6秒 → 会話はズレるが許容

1.2秒以下 → かなり自然

0.8秒以下 → ほぼ違和感なし

今は「イベント用途で十分実用レベル」です。

🧠 同期ズレを小さくする工夫

RTSPは個別接続なのでズレは出ますが、

イベント開始時に

全員に「Resyncボタン押してください」と言う

もしくは管理者が全体再接続トリガー

を入れるとズレがかなり揃います。

Udon側で:

public void ForceResync()

💡 ここまで来たら重要なのは「安定性」

これ以上削るよりも:

途中停止しない

音ズレしない

Questクラッシュしない

方が重要になります。

🏁 結論

あなたの現在の状態:

🔥 VRChatでの低遅延配信としてはかなり完成度が高い

もう「設計ミス」レベルではなく「最適化フェーズ」です。

もしよければ:

エンコーダは x264 / NVENC どちらですか?

fpsはいくつですか?

解像度は?

ここまで詰めれば「理論上の最終到達点」まで一緒に持っていけますよ。

— ちゃんのぞ —

いいですね、RTX 5070 + NVENC H.264 ならかなり有利です 🔥設定次第で 1.3 秒前後までは狙える可能性があります。

🎯 NVENCでの“低遅延特化”最適設定(VRChat向け)

📌 出力(詳細モード)

■ レート制御

CBR

■ ビットレート

720p30なら:

4000~6000 kbps

※上げすぎると逆にバッファが増えます

■ キーフレーム間隔

1

(すでに設定済みならOK)

■ プリセット

P1(Low Latency)または P2

RTX 50系なら P1 でも画質十分です。

■ チューニング

低遅延(Low Latency)

※「高画質」はNG

■ マルチパスモード

Single Pass

Two Pass は遅延増えます。

■ Look-ahead

OFF

■ Psycho Visual Tuning

OFF

■ Bフレーム

0

(これ超重要)

■ GPU

0

🎯 FPSについて

もし 60fps なら:

→ 30fpsにすると 0.2~0.4秒縮む可能性あり

VRChat内モニター用途なら30fpsで十分なケースが多いです。

🎯 音声設定

AAC

96kbps ~ 128kbps

サンプルレート 44.1kHz

音声も意外と遅延源になります。

🧠 なぜNVENCでも遅延が出るのか?

NVENCは高速ですが:

があると内部でバッファが発生します。

低遅延設定はそれを全部切る方向です。

📉 現実的な到達ライン

今:1.6秒

最適化後予想:

1.2~1.4秒

1秒切りはほぼ不可能です(VRCDN+VRChatの構造的に)。

🔥 さらに攻める裏技(上級)

① 解像度を 960×540 にする

体感差ほぼなし

② GOPを0.5秒にする

キーフレーム間隔を:

0.5

にするとさらに縮む可能性あります(ビットレート増えます)。

🎯 同期ズレを減らすテク

イベント開始直前に:

一度 Stop

0.2秒後 Start

を全員に実行させる

これでズレが揃いやすいです。

🏁 正直な評価

RTX 5070 + NVENC で 1.6 秒は優秀です。

ここからは:

の世界です。

もしよければ教えてください:

そこが分かれば「これ以上削れるかどうか」を断言できます。

— ちゃんのぞ —

それは……かなり凄いです。

0.7秒前後 は、ほぼ最速クラス です。

正直、ここまで詰められるケースはかなり少ないです。

🎯 なぜ一気に縮んだのか?

① 解像度 1920 → 1280

フレームあたりのエンコード負荷が約55%まで減少

② H.264 Profile を baseline

baseline は:

結果:

エンコード遅延減少

VRCDN側処理遅延減少

AVProデコード遅延減少

この組み合わせが効いています。

🏆 現在の状態の評価

構成:

OBS (NVENC baseline 1280p)

遅延:約0.7秒

これは理論上の限界にかなり近いです。

🧠 ここからさらに削れる?

正直に言うと:

🔥 ほぼ限界値です。

0.5秒を切るのは、

🎯 今後やるべきこと

ここからは「削る」よりも

① 安定性確保

長時間配信で止まらないか

音ズレしないか

視聴者増加時の挙動

② 同期ズレ最小化

0.7秒まで来ると、

イベント開始前に:

videoPlayer.Stop();

で全員リセットすると揃いやすいです。

③ 80人想定の確認

RTSPは:

なので、80人同時で0.7秒維持できるかは

10~20人なら問題なし。

💬 正直な評価

あなたの構成は:

🔥 VRChat低遅延配信として「完成形」

です。

ここまで来たらもう「設計者レベル」です。

👀 興味があれば次の話題

複数カメラ即時切替の低遅延維持方法

ワールド内での配信状態表示UI

遅延測定用の自動Ping表示システム

再接続自動化による同期改善

どこまで攻めますか?